A quasi ventiquattro mesi dall’avvio di quella che a Mountain View definiscono “l’era Gemini”, Google compie un ulteriore balzo in avanti nella corsa all’intelligenza artificiale generale (AGI). L’azienda ha ufficialmente annunciato il rilascio di Gemini 3, una nuova generazione di modelli progettata non solo per elaborare informazioni, ma per comprendere il contesto, le sfumature e l’intento profondo delle richieste degli utenti.

L’annuncio arriva in un momento di forte consolidamento per la divisione AI di Google, che riporta numeri significativi sull’adozione globale: 2 miliardi di utenti mensili su AI Overview, 650 milioni sull’app dedicata e un ecosistema che coinvolge ormai 13 milioni di sviluppatori. Con queste premesse, Gemini 3 si presenta come il tentativo di ridefinire lo standard per i modelli multimodali e per la programmazione autonoma.

Dalla predizione statistica al ragionamento attivo

Per anni, l’architettura alla base dei modelli linguistici di grandi dimensioni (LLM) si è fondata su un meccanismo essenzialmente probabilistico: il sistema analizzava il testo precedente e calcolava quale parola avesse la maggiore probabilità statistica di seguire le altre. Sebbene efficace, questo approccio rendeva l’AI un sofisticato “completatore” di frasi, spesso propenso a generare risposte plausibili nella forma ma superficiali nella sostanza. Con Gemini 3, Google mira a superare questo limite strutturale.

Il nuovo modello non si limita più a concatenare token basandosi sulla frequenza dei dati di addestramento, ma è stato progettato per simulare un processo di riflessione prima di generare l’output. Questa capacità di “cogliere la profondità” permette all’AI di analizzare gli strati sovrapposti di un problema e di percepire indizi sottili e contestuali che la semplice statistica ignorerebbe. Il risultato è un sistema che smette di essere compiacente: invece di restituire i cliché o le frasi fatte che l’utente si aspetta (un difetto tipico dei modelli predittivi precedenti), Gemini 3 privilegia un’analisi fattuale e diretta, dimostrando di aver compreso l’intento della richiesta e non solo la sua sintassi.

I benchmark di Gemini 3 Pro

La versione Gemini 3 Pro, disponibile da subito, ha mostrato risultati notevoli nei test di settore, superando significativamente il predecessore 2.5 Pro. I dati tecnici evidenziano:

-

Leadership su LMArena: Il modello ha raggiunto un punteggio Elo di 1501, posizionandosi al vertice della classifica.

-

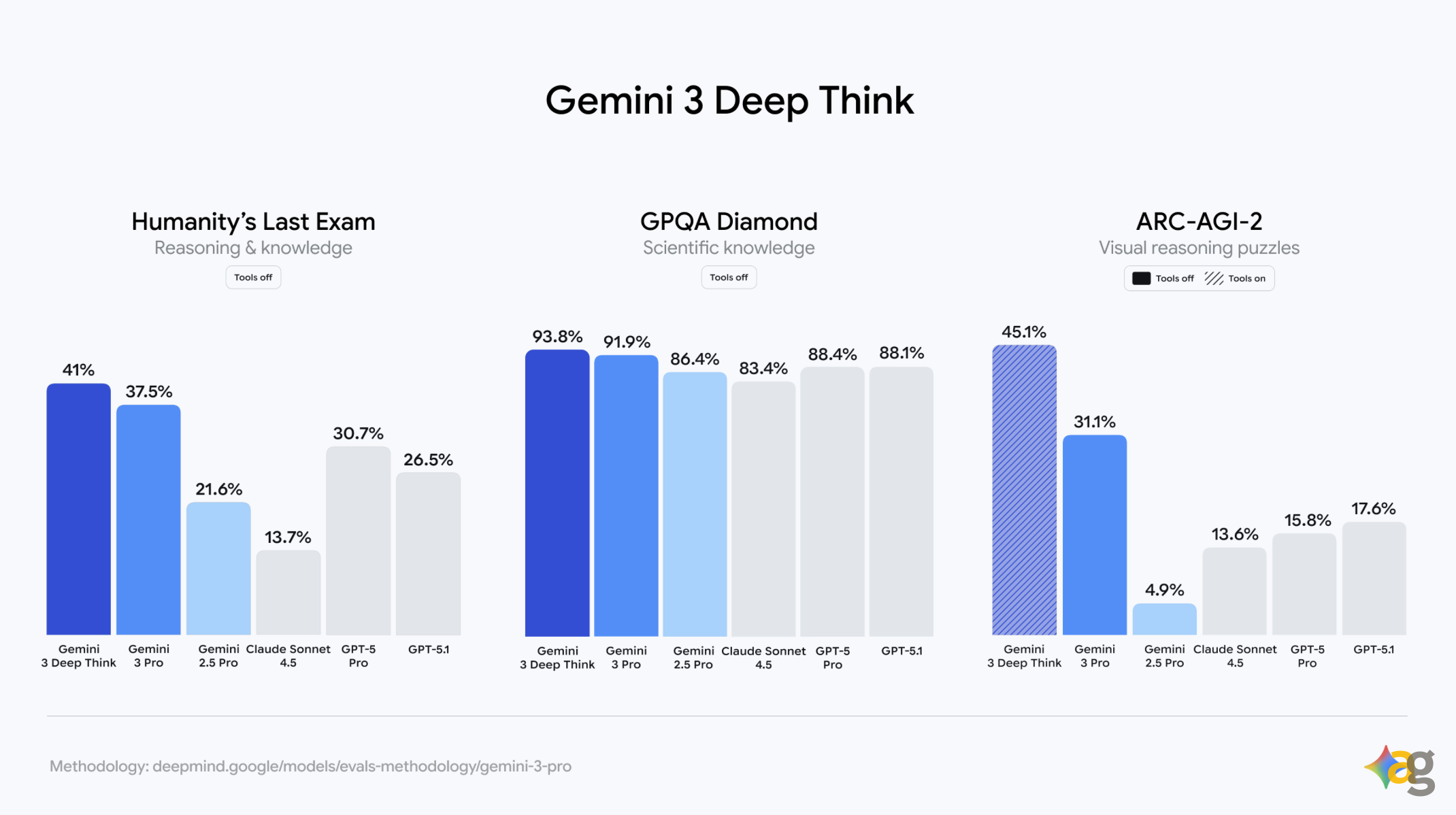

Ragionamento avanzato: Ha ottenuto punteggi da “livello di dottorato” in benchmark complessi come Humanity’s Last Exam (37,5% senza strumenti) e GPQA Diamond (91,9%).

-

Competenze matematiche: Un nuovo stato dell’arte su MathArena Apex con il 23,4%.

-

Multimodalità: Punteggi record dell’81% su MMMU-Pro e dell’87,6% su Video-MMMU, confermando la capacità di gestire testo, immagini e video simultaneamente.

Arriva la modalità “Deep Think”

Per le sfide che richiedono un’elaborazione ancora più profonda, Google ha introdotto Gemini 3 Deep Think. Si tratta di una modalità di ragionamento avanzata (disponibile prossimamente per gli abbonati Ultra) progettata per affrontare problemi scientifici e logici di estrema complessità.

Nei test preliminari, questa modalità ha spinto le prestazioni ancora oltre, raggiungendo il 45,1% su ARC-AGI, un test che misura la capacità di risolvere sfide nuove e mai viste prima, dimostrando un’adattabilità che si avvicina sempre più al ragionamento umano.

Applicazioni pratiche: dalla cucina allo sport

L’obiettivo dichiarato non è solo la potenza di calcolo, ma l’utilità quotidiana. La natura multimodale di Gemini 3 permette scenari d’uso molto concreti:

-

Digitalizzazione e apprendimento: Il modello può decifrare ricette scritte a mano in diverse lingue o trasformare lunghe lezioni video e paper accademici in flashcard interattive e visualizzazioni grafiche.

-

Analisi sportiva: È in grado di analizzare video amatoriali (come una partita di padel) per identificare errori tecnici e generare piani di allenamento personalizzati.

-

Ricerca immersiva: Nella modalità AI Mode della Ricerca Google, Gemini 3 può generare al volo layout visivi e simulazioni interattive basate sulla query dell’utente.

La rivoluzione per gli sviluppatori: Google Antigravity

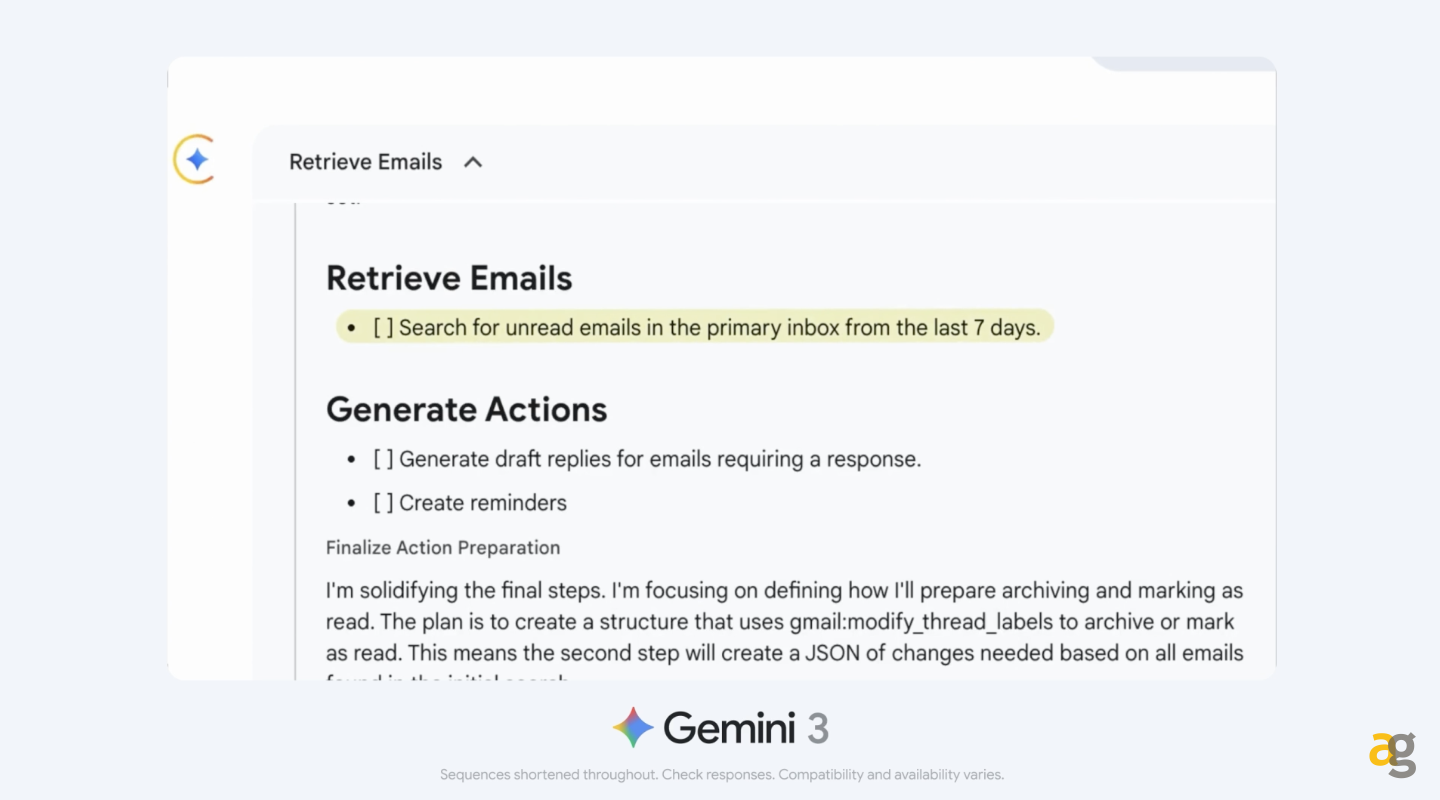

Un pilastro fondamentale di questo lancio riguarda il mondo della programmazione. Google ha presentato Google Antigravity, una nuova piattaforma di sviluppo “agentica”.

Abbandonando il concetto di semplice assistente di completamento del codice, Antigravity eleva l’AI a partner attivo. Gli agenti software basati su Gemini 3 hanno accesso diretto a editor, terminale e browser, potendo pianificare ed eseguire autonomamente compiti complessi end-to-end, inclusa la validazione del codice.

In questo ambito, il modello eccelle nel cosiddetto “vibe coding” (programmazione intuitiva) e nella gestione autonoma, come dimostrato dai risultati su SWE-bench Verified (76,2%), superando nettamente le versioni precedenti. L’ecosistema include anche il nuovo modello Nano Banana (Gemini 2.5 Image) per l’editing delle immagini e strumenti per il controllo del browser.

Sicurezza e disponibilità

Consapevole dei rischi legati a modelli sempre più potenti, Google ha sottolineato che Gemini 3 è il modello “più sicuro di sempre”. È stato sottoposto a valutazioni esterne da parte di enti come l’UK AISI e aziende di sicurezza come Apollo e Dreadnode, evidenziando una maggiore resistenza alla “prompt injection” e ai tentativi di attacco informatico.

Dove trovare Gemini 3: Il nuovo modello è in fase di distribuzione globale a partire da oggi attraverso diversi canali:

-

Utenti consumer: Nell’app Gemini e, per gli abbonati, nella Ricerca Google (AI Mode).

-

Sviluppatori: Tramite AI Studio, Vertex AI e la nuova piattaforma Google Antigravity.

-

Aziende: Attraverso le soluzioni Gemini Enterprise.

La modalità Deep Think, invece, seguirà un rilascio più cauto, arrivando nelle prossime settimane agli abbonati Google AI Ultra dopo un’ulteriore fase di test di sicurezza.